La plupart des gens utilisent aujourd’hui des outils d’IA tels que ChatGPT, car ils permettent de gagner du temps dans le cadre de projets académiques.

Les outils d’IA comme Grammarly et Quillbot ne sont pas considérés comme du plagiat (la plupart du temps), mais qu’en est-il de la référence à des outils d’IA dans vos essais/travaux ?

Eh bien, découvrons-le, voulez-vous ?

Alors, devriez-vous choisir des outils d’IA comme ChatGPT ?

Vous devez citer les outils d’IA dans votre travail conformément au guide de style utilisé par votre institution. Vous devez indiquer comment vous avez utilisé l’outil (y compris l’invite et la fonctionnalité (paraphrase, traduction, édition, etc.) dans la section des références de votre travail.

Vous ne devez pas citer les outils d’IA en tant qu’auteurs dans votre article académique, car les citations de ce type sont réservées aux auteurs accrédités. En effet, tout auteur doit être potentiellement tenu responsable de son travail, ce qui n’est pas le cas d’un outil d’intelligence artificielle.

Cela soulève la question de l’utilité des outils d’IA pour les travaux universitaires. Vous ne pouvez pas vraiment inclure un texte généré par ChatGPT car il ne peut pas être crédité et votre travail pourrait être considéré comme du plagiat. (Vous pouvez également vérifier le plagiat ici)

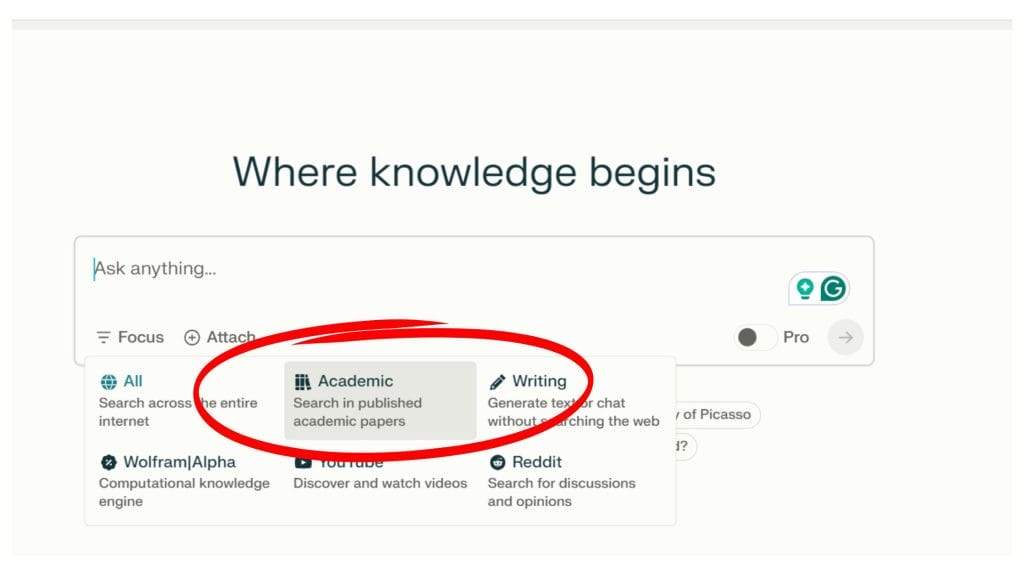

Les outils d’IA peuvent être utiles pour la recherche et la compréhension de concepts difficiles. Vous pouvez utiliser un moteur de recherche d’IA comme Perplexity AI pour vous aider à rechercher un sujet ou Google Gemini pour vous aider à en savoir plus sur un sujet.

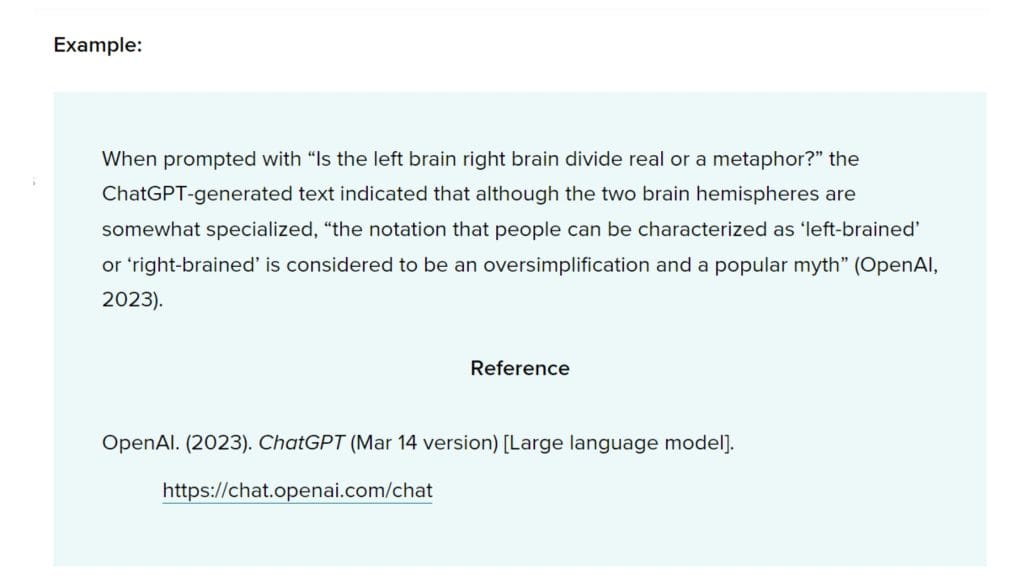

Faut-il citer ChatGPT selon le guide de style APA ?

L’équipe de l’APA a donné des indications sur la manière de citer ChatGPT conformément à son guide de style.

Selon l’APA, la citation d’un texte généré par un algorithme doit être citée par l’entreprise qui a créé l’algorithme (dans ce cas, Open AI).

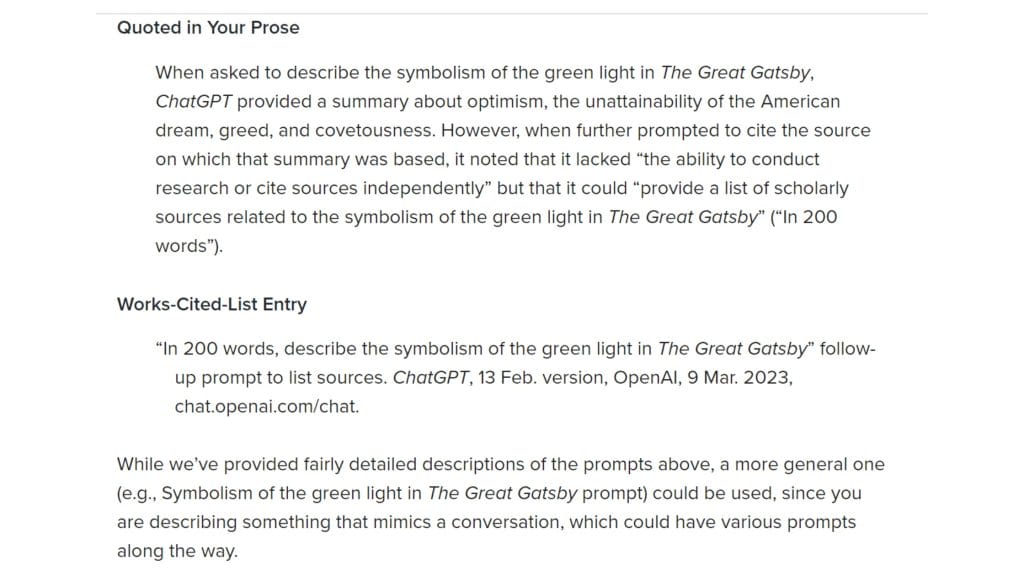

Voici un exemple qui vous montre comment citer ChatGPT si vous utilisez le guide de style APA :

Ils recommandent également de mettre en annexe les réponses complètes données par ChatGPT.

Ils reconnaissent également la nécessité d’un débat ouvert sur la question de savoir si l’on devrait ou non être autorisé à citer un outil d’intelligence artificielle tel que ChatGPT.

L’un des principaux problèmes est que les outils d’IA « hallucinent » souvent. Cela signifie qu’ils affirment avec confiance quelque chose qui n’est peut-être pas vrai. Même si les gens font souvent des erreurs, nous pouvons leur demander pourquoi ils sont arrivés à une telle conclusion. Avec un outil d’IA, ils utilisent souvent un lien incorrect ou simplement inventé comme référence.

Faut-il citer ChatGPT selon le guide de style MLA ?

Selon le guide de style MLA, vous devez citer des outils d’intelligence artificielle tels que ChatGPT dans votre travail.

Le guide de style MLA est censé être flexible dans l’utilisation des citations, mais voici un exemple de la manière dont vous devriez citer ChatGPT selon leur site web :

Voici un exemple de cas où vous utilisez ChatGPT à des fins de recherche et où vous utilisez les informations dans votre travail :

« Décrivez le symbolisme de la lumière verte dans le livre The Great Gatsby de F. Scott Fitzgerald ». ChatGPT, version du 13 février, OpenAI, 8 mars 2023, chat.openai.com/chat.

Les chats de ChatGPT sont désormais partageables. Vous devez donc utiliser le bouton situé dans le coin supérieur droit pour citer le chat exact que vous avez utilisé dans votre recherche.

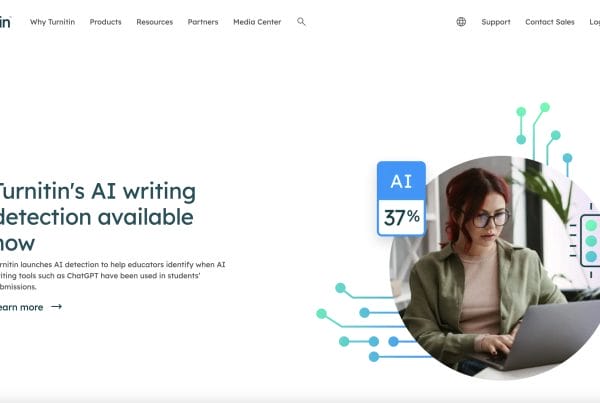

Comment vérifier si un texte a été écrit avec l’IA ?

De nombreuses écoles et universités sont actuellement confrontées à l’impact des outils d’IA tels que ChatGPT sur le travail académique.

Le fait qu’un outil d’IA puisse rédiger une dissertation entière à partir d’un simple message change tout.

Si vous souhaitez savoir si un texte a été écrit par une personne ou par un outil d’intelligence artificielle, vous devez prendre en compte les éléments suivants :

- Test du texte avec un outil de détection de l’IA

- Comparaison du texte avec les travaux antérieurs de l’élève

- Recherche de schémas dans les textes habituellement produits par l’IA (par exemple, faible variation de la longueur des phrases ou du vocabulaire présent).

Comme vous pouvez le voir dans mon texte ci-dessus, certains paragraphes sont longs et d’autres courts. J’utilise un langage varié, allant de l’informel au plus formel. Les outils d’IA ont tendance à utiliser des mots plus homogènes car ils sont formés pour prédire les résultats les plus courants.

N’accusez pas un élève d’utiliser un outil d’IA sans preuves suffisantes ou sans en parler à votre conseil d’éducation.

Notre outil Winston AI a un taux de précision de 99,98 % pour la détection de contenu AI.

Notre outil est facile à utiliser. Il vous suffit de copier votre texte dans notre application et de le scanner (cela prend environ 3 secondes).

Vous pouvez l’essayer gratuitement pendant 7 jours ici.

Quels sont les éléments les plus importants à prendre en compte lors de l’utilisation d’un outil d’IA tel que ChatGPT pour la rédaction d’articles académiques ?

Voici quelques-uns des problèmes que pose l’utilisation de ChatGPT lors de la rédaction d’articles académiques :

Droits d’auteur

Comme les outils d’IA utilisent une variété de sources pour compiler leurs informations, il est impossible de trouver un auteur pour un texte donné. Il est donc plus difficile de débattre de la véracité d’une chose si l’on ne dispose pas d’un point de départ précis.

Fiabilité et traçabilité

Les premiers outils d’IA étaient notoirement peu fiables et l’un de leurs principaux problèmes est qu’ils manquent d’esprit critique et de capacité à douter. Ils présentent souvent les informations comme des faits alors qu’elles peuvent être nuancées ou subjectives.

Un autre problème qui se pose pour l’IA en général est celui de la traçabilité. Si nous connaissons le fonctionnement théorique de l’IA, nous ignorons souvent comment l’IA parvient à des conclusions ou les étapes nécessaires à l’apprentissage d’un élément de données spécifique. Cela devient évidemment un problème, plus nos modèles d’IA deviennent complexes.

Des institutions différentes, une politique différente

Le débat sur la question de savoir s’il faut autoriser l’utilisation d’un outil d’IA dans le domaine de l’éducation risque de faire rage à jamais. La plupart des établissements universitaires sont susceptibles de traiter les outils d’IA de la même manière que Wikipédia ou d’autres forums en ligne tels que Reddit ou Quora. Ces sites ne sont pas des sources d’information fiables car la plupart des informations qui y figurent sont générées par les utilisateurs et sont subjectives.

Des institutions différentes auront probablement des politiques différentes et accepteront des outils/modèles différents. Cela rend le référencement des outils d’IA de plus en plus complexe au fur et à mesure que la technologie se développe (et elle se développe rapidement !).